- وقع حوالي ألف موظف من Google وOpenAI على رسالة مفتوحة تطالب بوضع حدود واضحة للاستخدامات العسكرية للذكاء الاصطناعي

- تدعو الرسالة شركات التكنولوجيا للضغط ضد خطط الحكومة لمراقبة الذكاء الاصطناعي والأسلحة المستقلة

- تعكس هذه الخطوة التوتر المتزايد داخل صناعة الذكاء الاصطناعي بشأن عقود الحكومة والشراكات الدفاعية

وقع قرابة ألف موظف من Google وOpenAI على رسالة مفتوحة تحث شركاتهم على مقاومة الضغط من الجيش الأمريكي لتخفيف القيود على كيفية استخدام أنظمة الذكاء الاصطناعي. تصرح الرسالة “لن نتقسم” حول هذا الموضوع، حتى بعد أن اعتبرت وزارة الدفاع شركة Anthropic “خطرًا على سلسلة الإمدادات” بعد أن رفضت السماح باستخدام تقنيتها في المراقبة الجماعية المحلية أو الأسلحة المستقلة بالكامل.

أصابت هذه الخطوة العديد من المراقبين في وادي السيليكون بالدهشة وأثارت قلقًا واسعًا بين المهندسين الذين يبنون نماذج الذكاء الاصطناعي المتقدمة اليوم. خاصة أن OpenAI وGoogle تجريان مفاوضات للإبقاء على الترتيب الذي رفضته Anthropic.

إطار الرسالة يستخدم لغة صريحة بشكل غير عادي في صناعة معروفة بالاتصالات الحذرة. تدعي الرسالة أن المسؤولين الحكوميين يحاولون الضغط على شركات الذكاء الاصطناعي للتخلي عن بعض الحدود الأخلاقية.

“إنهم يحاولون تقسيم كل شركة بخوف أن تستسلم الأخرى. هذه الاستراتيجية تعمل فقط إذا لم يعرف أي منا أين يقف الآخرون”، تقول الرسالة. “تعمل هذه الرسالة على خلق فهم مشترك وتضامن في مواجهة هذا الضغط من وزارة الحرب.”

تعتبر الرسالة المفتوحة بارزة لأنها تشمل أشخاصًا من شركات منافسة عادةً ما تتنافس بشراسة. الحجة التي يقدمونها هي أن الذكاء الاصطناعي أصبح قويًا بما يكفي بحيث لا يمكن اعتبار القرارات المتعلقة باستخدامه اتفاقيات تجارية روتينية.

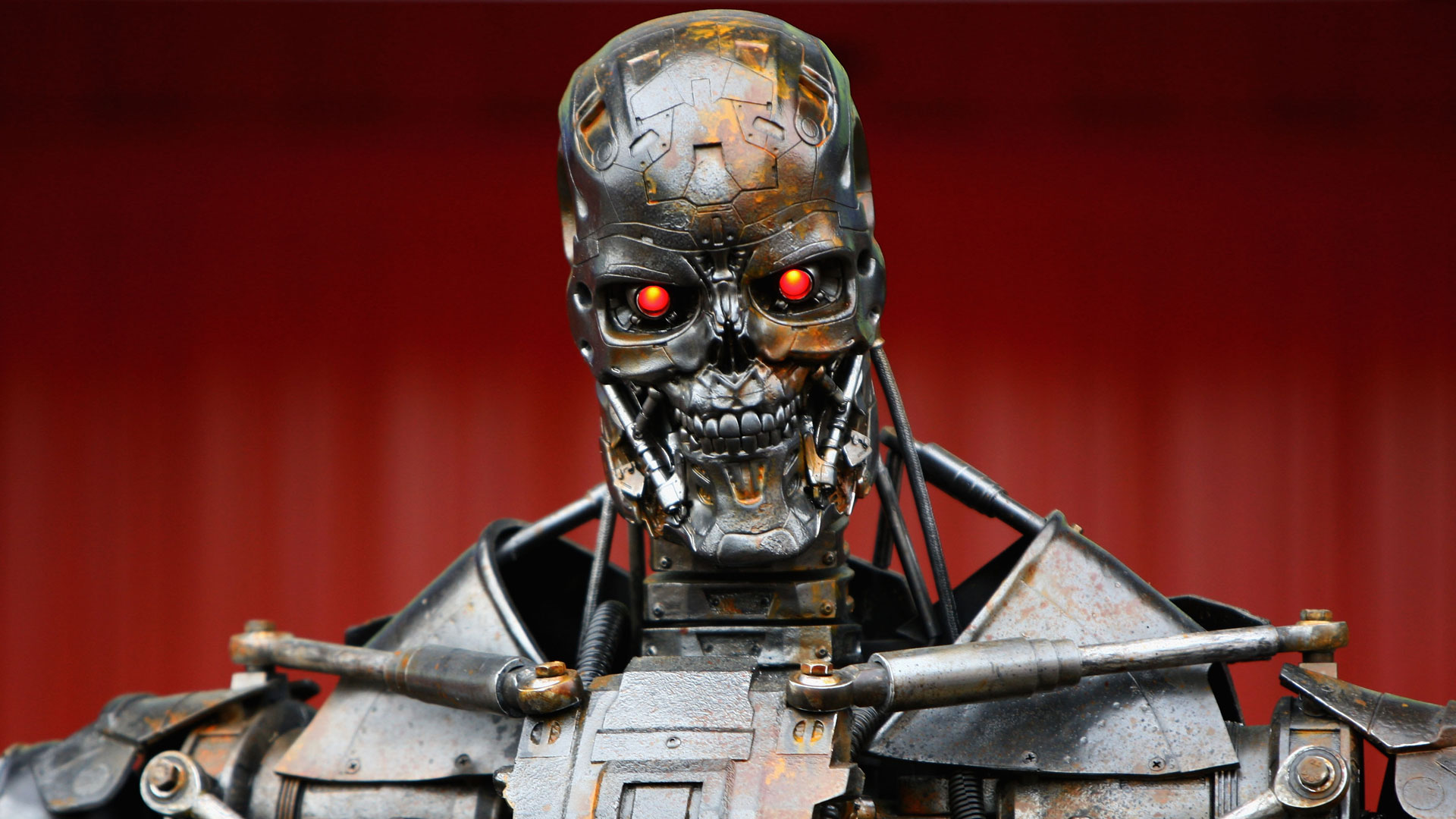

هذه المخاوف ليست نظرية فقط. الحكومات في جميع أنحاء العالم تستكشف كيف يمكن دمج الذكاء الاصطناعي في تخطيط الدفاع وتحليل الاستخبارات. لطالما استخدمت الوكالات العسكرية أدوات برمجية للمراقبة والتوجيه. يمكن أن تسرع النماذج التوليدية المتقدمة من تلك القدرات بشكل كبير. وعندما تظهر الدراسات كيف يفضل الذكاء الاصطناعي الخيار النووي في ألعاب الحرب، يبدو من الأسوأ حتى السماح له بالتحكم في أنظمة الأسلحة والمراقبة.

حرب الذكاء الاصطناعي

تمثل هذه الخطوة تحولًا طفيفًا بالنسبة لعمال Google، الذين احتج الآلاف منهم على مشاركة الشركة في خطة مشروع Maven التابعة للبنتاغون، لاستخدام تعلم الآلة لتحليل لقطات الطائرات بدون طيار في عام 2018. بعد رد فعل داخلي واسع، سمحت Google في النهاية بانتهاء ذلك العقد ونشرت مجموعة من الإرشادات الأخلاقية المعروفة بمبادئ الذكاء الاصطناعي الخاصة بها.

كانت تلك المبادئ تهدف إلى تحديد كيفية تعامل Google مع استخدامات الذكاء الاصطناعي الحساسة. في ذلك الوقت، قالت الشركة إنها لن تطور تقنيات تهدف إلى إيذاء أو تمكين المراقبة التي تنتهك المعايير الدولية. تشير الرسالة المفتوحة الأخيرة إلى أن توترات مماثلة تتجدد مع اهتمام الحكومات المتزايد بنشر نماذج لغوية قوية.

قد تؤدي الرسالة إلى تغيير أو عدم تغيير القرارات المؤسسية، لكن على الأقل يمكن للعمال الإشارة إليها كرسالة لا يمكن سوء فهمها.

تابع TechRadar على Google News و أضفنا كمصدر مفضل للحصول على أخبارنا، ومراجعاتنا، وآرائنا الخبيرة في خلاصة أخبارك. تأكد من الضغط على زر المتابعة!

وبالطبع يمكنك أيضًا متابعة TechRadar على TikTok للحصول على أخبار، ومراجعات، وفيديوهات تفكيك، وحصولك على تحديثات منتظمة منا عبر واتساب كذلك.